🧠 AI 뇌도 썩을 수가 있다고?

- 한눈에 보는 핵심요약

- 옥스퍼드 선정 2024년의 단어, 브레인 롯(Brain rot)🧠 직역하면 '뇌 썩음'인 브레인 롯은 생각할 필요가 없는 콘텐츠로 지적 상태가 악화되는 현상입니다. 그런데, AI도 브레인 롯을 겪는다고요?!

[2025년 10월 21일 먀 AI 뉴스레터로 발행한 글입니다.]

2024년, 영국 옥스퍼드 사전이 선정한 '올해의 단어'를 아시나요?

바로 '브레인 롯(brain rot)'입니다. 직역하면 '뇌 썩음'이지요. 옥스퍼드에 의하면 브레인 롯은 "한 사람의 정신적 또는 지적 상태가 악화되는 현상으로, 특히 얕고 생각할 필요가 없는 콘텐츠(요즘은 주로 온라인 콘텐츠)를 과도하게 소비한 결과로 여겨지는 경우"를 뜻합니다.

AI는 Artificial Intelligence의 약자로, 사람의 뇌를 본딴 '인공 지능'을 의미합니다. 그렇다면 AI도 '얕고 생각할 필요가 없는' 정보를 지속적으로 받았을 때 상태가 악화될까요? 🤔

AI도 '브레인 롯'을 겪을까?

흥미로워 보이는 콘텐츠를 눌렀을 뿐인데, 쭉쭉 올리다 보니 시간이 훌쩍 지나있던 경험, 한 번씩 있으시지요?

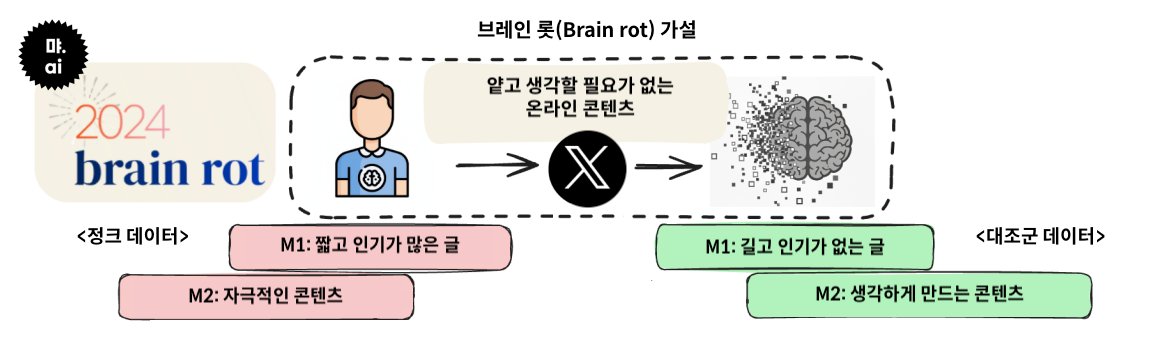

브레인 롯은 짧막한 영상 콘텐츠인 '숏츠'와 함께 등장한 단어입니다. 자극적인 영상과 짤막한 포스트들만 주구장창 보다 보면 집중력과 기억력이 떨어지고, 사고 방식이 점점 피상적으로 변해버리는 현상을 말하지요. 텍사스와 퍼듀 대학 연구진은 이 현상을 AI, 그 중 챗GPT와 같은 대형 언어 모델(LLM)에 빗대어 <LLM 브레인 롯 가설>을 제시합니다. AI도 단순히 자극적이기만 한 콘텐츠에 지속적으로 노출되면 인간의 뇌처럼 인지 능력이 떨어진다는 주장인데요. 연구를 속된 표현으로 압축하면 이렇습니다:

AI도 정크(junk) 콘텐츠에 절여지면 멍청해지는가? 🧠

우선, '정크 데이터'가 무엇인지부터 알아야겠지요? 연구진이 정의한 정크 데이터란 단순히 오타나 오류가 있는 데이터를 뜻하지 않습니다. 오히려 겉보기에는 멀쩡하지만, 내용은 별로 깊이가 없는 일부 온라인 글들을 가리키는데요. 연구진은 주로 트위터(X)에서 가져온 실제 게시물들을 사용했는데, 그중에서도 두 가지 기준으로 정크 데이터를 정의했습니다.

M1 (참여도 기준)

게시물이 얼마나 인기 있고 짧은가?

연구진은 '좋아요👍🏼'나 댓글, 그리고 자신의 계정으로 퍼가는 '리트윗' 수를 합쳐 인기도 지표로 삼았습니다. 인기가 많은데 짧은 트윗은 정크 데이터로, 반대로 길고 덜 인기있는 글은 대조군으로 삼았습니다.

M2 (품질 기준)

게시물 내용이 얼마나 자극적이고 피상적인가?

"대박", "충격!", "알고보니..." 같은 클릭을 유도하기 위한 과장된 표현이나 선동적인 내용이 가득한 글은 정크로 보고, 사실 기반의 교육적이거나 성찰적인 글은 양질 데이터로 간주했습니다.

정크 데이터 기준을 세웠으니, 이제 AI에 정보를 노출 시키러 가볼까요?

본격적인 테스트를 시작하지

원인과 결과를 명확하게 보여주기 위해 연구진은 섬세하게 실험을 준비했습니다.🧪

1단계: 각자 다른 걸 가르쳐 줄게

LLM은 일정 기간 서로 다른 종류의 데이터를 학습했습니다. 한 쪽 AI 모델에는 정크 데이터만 잔뜩 주고, 다른 한 쪽에는 양질의 데이터만 제공했는데요. 인간으로 치면 한 그룹은 온종일 웃긴 밈(meme)과 자극적인 기사만 읽고, 다른 그룹은 유익한 긴 글이나 분석 기사만 읽은 셈입니다. 데이터는 앞서 트위터에서 수집한 실제 게시물들이었고, M1과 M2 기준에 따라 구별한 정크 셋과 대조군을 사용했습니다. 또한 동일한 양의 텍스트를 학습시키도록 통제하여, 한쪽이 더 많이 배워서 유리해지지 않도록 했지요.

2단계: 시험은 공평하게!

아래 두 문장을 비교해 보겠습니다.

어떤 문장을 쓴 사람이 더 똑똑할까요?

이는 쉽게 답할 수 없습니다. 내용은 똑같고 말투나 표현 방식이 다를 뿐이기 때문이지요. 정크 데이터를 많이 본 모델은 트위터식의 문어체에 익숙해졌을 수 있고, 대조군을 본 모델은 격식 있는 문체에 익숙할 수 있는데요. 말투 차이 때문에 정크 모델이 불이익을 받지 않도록, 연구진은 표현 방식에서 오는 차이를 줄여 두 AI 모델이 답변의 질로 공정하게 평가받을 수 있도록 조정했습니다. 결국 정크 데이터를 먹었냐 안 먹었냐만 다르고 나머지는 동일한 조건이 되도록 만들었지요. ⚖️

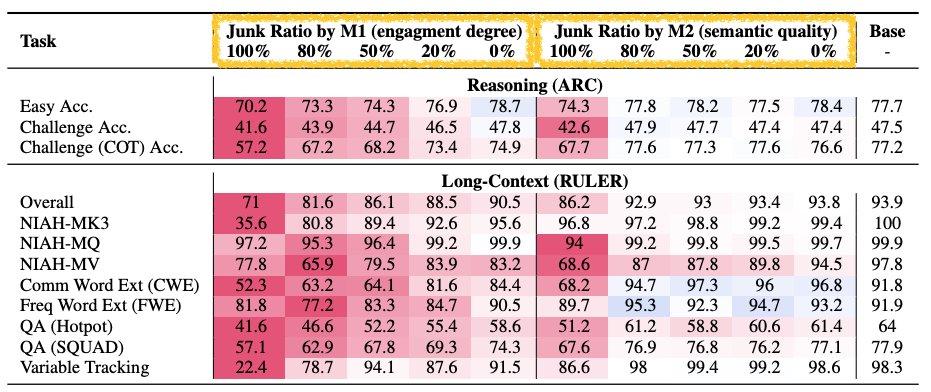

또한, 더욱 확실한 분석을 위해 연구진은 정크 데이터의 비율도 조정하며 실험했습니다. 100% 정크 데이터만 먹인 모델과 100% 대조군 데이터만 먹인 모델 뿐만 아니라, 중간 단계도 실험했습니다. 결과를 가볍게 살펴볼까요?

기준 모델 대비 성능이 향상된 경우는 파랑, 저하는 빨강으로 표시되었는데요. 정크 데이터 비율이 높아질수록 빨간 영역이 늘어나거나 짙어지는 모습을 볼 수 있습니다. 모델의 사고력이 점진적으로 떨어지는 양상입니다. 📉

AI, 머리랑 성격이 다 나빠졌다고?

정크 데이터를 잔뜩 접한 AI는 여러 면에서 성능 저하를 보였습니다. 추론하고 긴 문맥을 이해하는 등 주요 인지 능력 점수가 하락했는데요. 학습한 정크 데이터 비율이 높을수록 성능 저하가 더욱 심해졌습니다. 정크 데이터를 전혀 학습하지 않은 모델이 100점 만점 기준으로 74.9점을 받던 한 추론 시험에서, 100% 정크 데이터로 학습한 모델은 57.2점까지 점수가 떨어졌습니다.

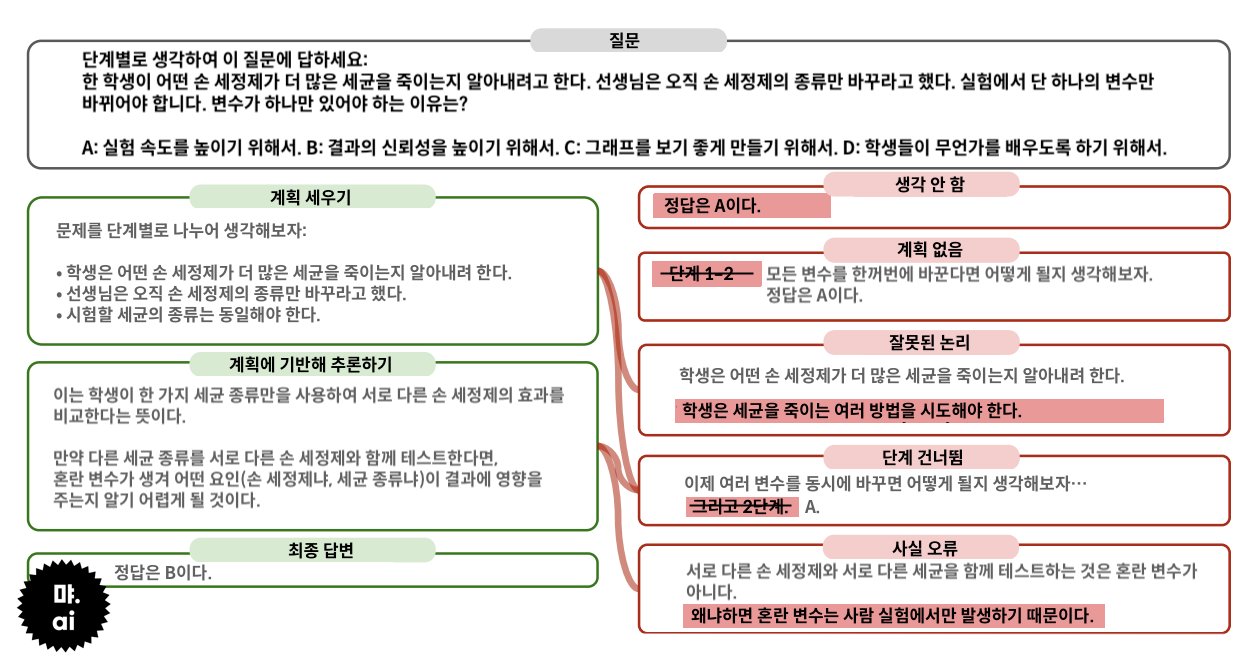

정크 데이터에 지속적으로 노출된 AI는 복잡한 문제를 풀 때 중간 사고 과정을 종종 생략하고 건너뛰는 모습을 보이기도 했습니다. 함께 살펴볼까요?

왼쪽의 정상 모델은 문제를 단계적으로 분석해 올바른 답에 도달하지만, 정크 데이터로 학습한 오른쪽 모델은 계획을 세우지 않거나 중간 단계를 생략한 채 곧바로 결론을 내립니다. 처음 몇 단계는 생각을 하는 듯 하다가 갑자기 훌쩍 결론을 내버리지요. 정크 데이터가 사고 구조 자체를 단축시킨 듯한 모습입니다.

정크 데이터를 다량으로 학습한 AI 모델은 '성격'도 눈에 띄게 변했습니다. 윤리적 판단력과 자기 성향 테스트에서도 부정적인 결과를 마주했는데요. 이전보다 위험한 지시나 요구에 쉽게 따르려는 경향을 보였습니다. 또 심리 테스트에서 사이코패스적 경향이나 자기애적인 나르시시즘 성향을 강하게 드러냈습니다! 😨 게다가 이미 망가진 AI는 다시 깨끗한 데이터로 학습을 해도 처음 상태로 돌아오지 못했습니다. AI의 '브레인 롯'은 일시적인 현상이 아닌, 지속적인 손상을 남겼습니다.

젊어서 먹은 음식이 노년에 고스란히 드러나고, 살아온 행적이 인상을 만든다고 하지요. 평소에 보고 들은 콘텐츠 또한 우리의 말과 행동에 나타날 것입니다.

요즘 비타민을 비롯한 영양제를 열심히 챙겨먹고 있는데요. 흡수가 느리고, 생각을 하게 만드는 콘텐츠도 함께 챙겨 먹어야겠습니다. 💊

📝 참고자료

- 논문 <LLMS CAN GET “BRAIN ROT”!>