robots.txt 설정 방법: 네이버·구글 검색 노출을 좌우하는 필수 SEO 설정 가이드

- 한눈에 보는 핵심요약

- robots.txt는 검색엔진 크롤러의 접근 범위를 제어하는 파일로, 잘못 설정하면 사이트 전체가 검색에서 제외될 수 있습니다. 기본 구조와 차단/허용 설정만 제대로 이해해도 크롤링 효율과 SEO 성과를 동시에 개선

robots.txt 설정 방법: 검색 노출 막히는 이유와 실무 체크리스트

콘텐츠가 계속 쌓이는데도 검색 노출이 안 된다면, 원인은 robots.txt 한 줄일 수 있습니다. 실무 기준으로 보면 크롤링 차단 설정 오류가 생각보다 자주 발생합니다. 이 글에서는 robots.txt의 역할부터 실무 설정, AI 크롤러 대응까지 핵심만 정리합니다.

검색 노출이 안 되는 이유, 혹시 robots.txt 때문인가요?

콘텐츠는 계속 발행하고 있는데 검색 유입이 없다면, 마케터 관점에서 가장 먼저 의심해볼 요소가 있습니다.

바로 robots.txt 설정입니다.

실무 기준으로 보면 아래 케이스가 반복적으로 발생합니다.

1) 테스트 중 Disallow: /를 그대로 유지

2) 관리자 페이지 차단하다 전체 차단

3) 사이트맵 경로 오류

최근 AI 크롤러까지 등장하면서 robots.txt는 단순 설정이 아니라

크롤링 전략 영역으로 넘어가고 있습니다.

*본 콘텐츠는 리드젠랩 블로그 게시물(robots.txt란? 검색 노출 만드는 필수 작업)을 요약한 글입니다.

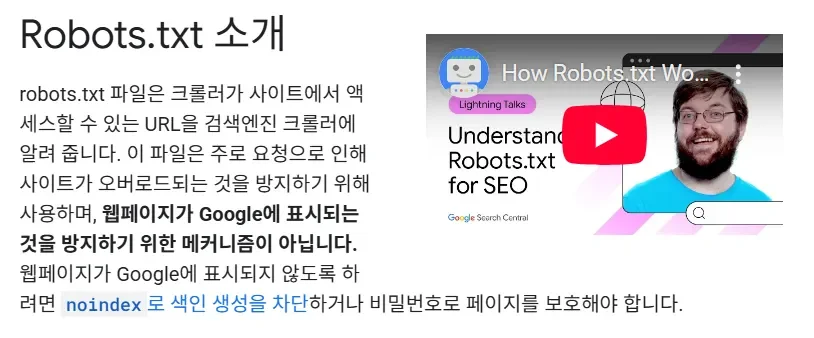

robots.txt란?

robots.txt는 검색엔진 크롤러에게 여기까지 들어와도 된다 / 안 된다고 알려주는 출입 가이드 파일입니다.

쉽게 말하면, 검색엔진의 동선 설계 문서라고 이해하는 경우가 많습니다.

robots.txt가 중요한 이유 3가지

1. 크롤링 범위 제어

1) 관리자 / 결제 / 로그인 페이지 차단

2) 불필요한 페이지 검색 노출 방지

[ 실무 예시 ]

/admin

/cart

/login

2. 크롤 버짓 최적화

검색엔진은 사이트를 무한히 크롤링하지 않습니다.

1) 불필요한 페이지 차단

2) 핵심 콘텐츠 집중 크롤링

검색 반영 속도 개선으로 이어질 수 있습니다.

3. 사이트 구조 전달

robots.txt에 sitemap을 넣으면 크롤러가 사이트 구조를 빠르게 이해합니다.

신규 콘텐츠 노출 속도 개선에 도움이 됩니다.

robots.txt 기본 구조

User-agent: *

Disallow: /admin/

Sitemap: https://example.com/sitemap.xml

1. User-agent

- Googlebot → 구글

- Yeti → 네이버

- Bingbot → Bing

- User-agent: * → 전체 크롤러

2. Disallow / Allow

- Disallow → 접근 제한

- Allow → 접근 허용

[ 핵심 규칙 ]

1) 반드시 /로 시작

2) 폴더 단위는 /admin/ 형태

3. Sitemap

전체 URL(https 포함)로 작성해야 합니다.

실무에서 가장 많이 쓰는 robots.txt 설정 3가지

1. 전체 허용 기본형

User-agent: *

Disallow:

Sitemap: https://example.com/sitemap.xml

가장 안전한 기본 설정입니다.

2. 특정 폴더 차단

User-agent: *

Disallow: /admin/

Disallow: /private/

실무에서 가장 많이 사용하는 구조입니다.

3. AI 크롤러 선택 차단

User-agent: GPTBot

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: *

Allow:

최근 흐름으로 보면

검색엔진은 허용하고 AI만 차단하는 전략이 늘고 있습니다.

실무에서 가장 많이 터지는 문제

1. 전체 사이트 차단 사고

User-agent: *

Disallow: /

검색 결과에서 사이트 전체가 제외될 수 있습니다.

2. 슬래시 누락

Disallow: admin (X)

Disallow: /admin/ (O)

3. 보안 용도로 착각

robots.txt는 접근 차단이 아니라

크롤링 요청 제한에 가깝습니다.

robots.txt 실무 체크리스트

1) robots.txt가 루트 도메인에 있는가

2) Disallow: / 실수는 없는가

3) 경로가 /로 시작하는가

4) sitemap이 전체 URL인가

5) 브라우저에서 직접 확인했는가

6) AI 크롤러 정책을 반영했는가

이 6개만 체크해도 대부분의 문제를 예방할 수 있습니다.

마케터 기준 핵심 인사이트

1) robots.txt는 직접적인 랭킹 요소는 아닙니다.

2) 하지만 크롤링 → 인덱싱 → 노출 속도에는 영향을 줍니다.

특히 아래 사이트에서 중요도가 높습니다.

1) 쇼핑몰(필터 URL 많은 구조)

2) 콘텐츠 대량 생산 사이트

3) 신규 페이지가 자주 생성되는 서비스

결국 핵심은 하나입니다.

검색엔진이 어디를 먼저 보게 만들 것인가!

robots.txt는 단순한 파일이지만 SEO 전체 흐름을 좌우하는 시작점입니다.

특히 AI 크롤러까지 고려해야 하는 지금, 단순 설정이 아니라 전략 영역으로 보는 것이 자연스럽습니다.

마케터분들은 현재 크롤링 전략까지 포함한 SEO 운영을 하고 계신가요?

함께 읽으면 좋은 글

1) 오늘 본 콘텐츠 자세히 보러가기

2) 메타 타이틀 작성법: SEO에서 GEO/AEO까지 연결하는 제목 설계

3) GEO의 본질: AI 인용 구조 이해하기

robots.txt 설정,

우리 사이트 기준으로 점검해보고 싶으신가요?

크롤링 구조부터 AI 크롤러 대응까지 실무 기준으로 진단해드립니다.